चीनी प्रौद्योगिकी कंपनी Baidu इंक के एआई शोधकर्ताओं की एक टीम एलएलएम की विश्वसनीयता और पता लगाने की क्षमता में सुधार के लिए डिज़ाइन किए गए एक नए तर्क ढांचे का प्रस्ताव कर रही है।समूह ने एक प्रकाशित किया हैकागज़पर उनके विचारों का वर्णनarXivप्रीप्रिंट सर्वर.

पिछले कुछ वर्षों में, चैटजीपीटी जैसे एलएलएम मुख्यधारा के एप्लिकेशन बन गए हैं, जिसमें उपयोगकर्ता लिखने की अपनी क्षमताओं का लाभ उठा रहे हैंदस्तावेज़, चित्र बनाएं और यहां तक कि गीत भी लिखें।

लेकिन एलएलएम की एक स्पष्ट कमजोरी बनी हुई है - अपने स्वयं के परिणामों की जांच करने में असमर्थता यह सुनिश्चित करने के लिए कि वे कभी-कभी उपयोगकर्ताओं को "मतिभ्रम" के साथ प्रस्तुत नहीं करते हैं, जो ऐसे परिणाम हैं जिनका कोई मतलब नहीं है।यह कमज़ोरी AI ऐप्स को उन अधिक महत्वपूर्ण अनुप्रयोगों के लिए उपयोग करने से रोकती है जिन पर भरोसा किया जाता हैआंकड़ा शुचिता.

इस नए प्रयास में, Baidu की टीम एक रणनीति लेकर आई है जिसका उद्देश्य एलएलएम को अंतिम उपयोगकर्ताओं के सामने परिणाम पेश करने से पहले अपने काम की जांच करने के लिए मजबूर करना है।

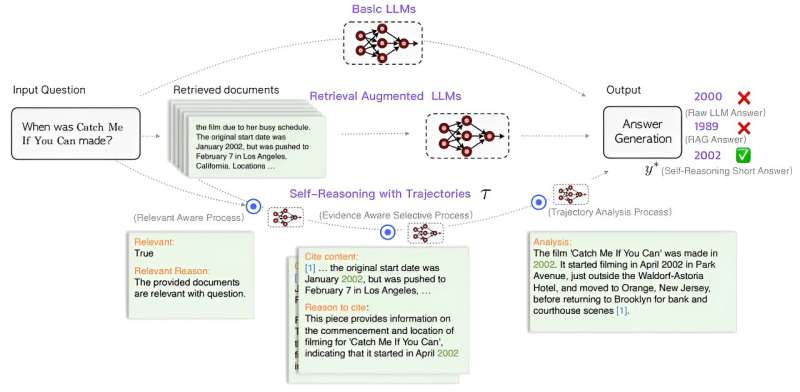

नए दृष्टिकोण में परिणामों की प्रस्तुति से ठीक पहले एलएलएम इंजन में तीन-चरणीय प्रक्रिया जोड़ना शामिल है।सबसे पहले परिणामों का आकलन करने और उपयोगकर्ता संकेत के लिए उनकी प्रासंगिकता के आधार पर उनका मूल्यांकन करने के लिए एक प्रासंगिक-जागरूक मॉडल जोड़ना है।दूसरे में एक साक्ष्य-जागरूक चयनात्मक विकल्प शामिल है जिसमें प्रासंगिक दस्तावेजों को उद्धरण के लिए चुना जाता है और अंशों को उत्तर की शुद्धता के प्रमाण के रूप में प्रस्तुत किया जाता है।तीसरे में एक प्रक्षेपवक्र विश्लेषण मॉड्यूल शामिल है जो पिछले दो मॉड्यूल के परिणामों के आधार पर स्पष्ट और संक्षिप्त विश्लेषण करता है।इसके बाद यह उपयोगकर्ता को अंतिम उत्तर प्रदान करता है।

शोध टीम का सुझाव है कि यह दृष्टिकोण एलएलएम को उपयोगकर्ताओं को दिए गए उत्तरों के बारे में अधिक जागरूक होने के लिए मजबूर करेगा, जिससे अंततः सटीकता में सुधार होना चाहिए।टीम ने उनका परीक्षण भी किया हैविचारोंएलएलएम में परीक्षण मॉड्यूल जोड़कर और फिर संकेत लिखकर।उनका दावा है कि बेहतर एलएलएम बहुत छोटे प्रशिक्षण डेटासेट का उपयोग करके जीपीटी-4 से बेहतर प्रदर्शन करने में सक्षम थे।

शोधकर्ताओं का सुझाव है कि उनके जैसे ढांचे अधिक विश्वसनीय एलएलएम को जन्म दे सकते हैं, जो उन्हें अधिक अनुप्रयोगों के लिए उपयुक्त बना सकता है।उनका यह भी सुझाव है कि वे अधिक खिलाड़ियों के लिए मैदान खोलेंगे जिनके पास वर्तमान में बड़े पैमाने पर प्रशिक्षण डेटासेट तक पहुंच नहीं है।

अधिक जानकारी:युआन ज़िया एट अल, स्व-तर्क के साथ पुनर्प्राप्ति संवर्धित भाषा मॉडल में सुधार,arXiv(2024)।डीओआई: 10.48550/arxiv.2407.19813

जर्नल जानकारी: arXiv

© 2024 साइंस एक्स नेटवर्क

उद्धरण:टीम एलएलएम की विश्वसनीयता और पता लगाने की क्षमता में सुधार लाने के उद्देश्य से एक तर्क ढांचे का प्रस्ताव करती है (2024, 31 जुलाई)31 जुलाई 2024 को पुनः प्राप्तhttps://techxplore.com/news/2024-07-team-framework-aimed-reliability-traceability.html से

यह दस्तावेज कॉपीराइट के अधीन है।निजी अध्ययन या अनुसंधान के उद्देश्य से किसी भी निष्पक्ष व्यवहार के अलावा, नहींलिखित अनुमति के बिना भाग को पुन: प्रस्तुत किया जा सकता है।सामग्री केवल सूचना के प्रयोजनों के लिए प्रदान की गई है।