日本研究人員使用大規模語言模型(LLM)有效地開發了對話人工智慧中的多種人格特徵。名古屋大學資訊學研究生院的Takaya Arita 教授和Reiji Suzuki 副教授團隊利用博弈論中的囚徒困境,創建了一個進化AI 代理的框架,該框架通過在自私和合作行為之間切換來模仿人類行為,並通過進化過程調整其策略。他們的發現是發表在科學報告。

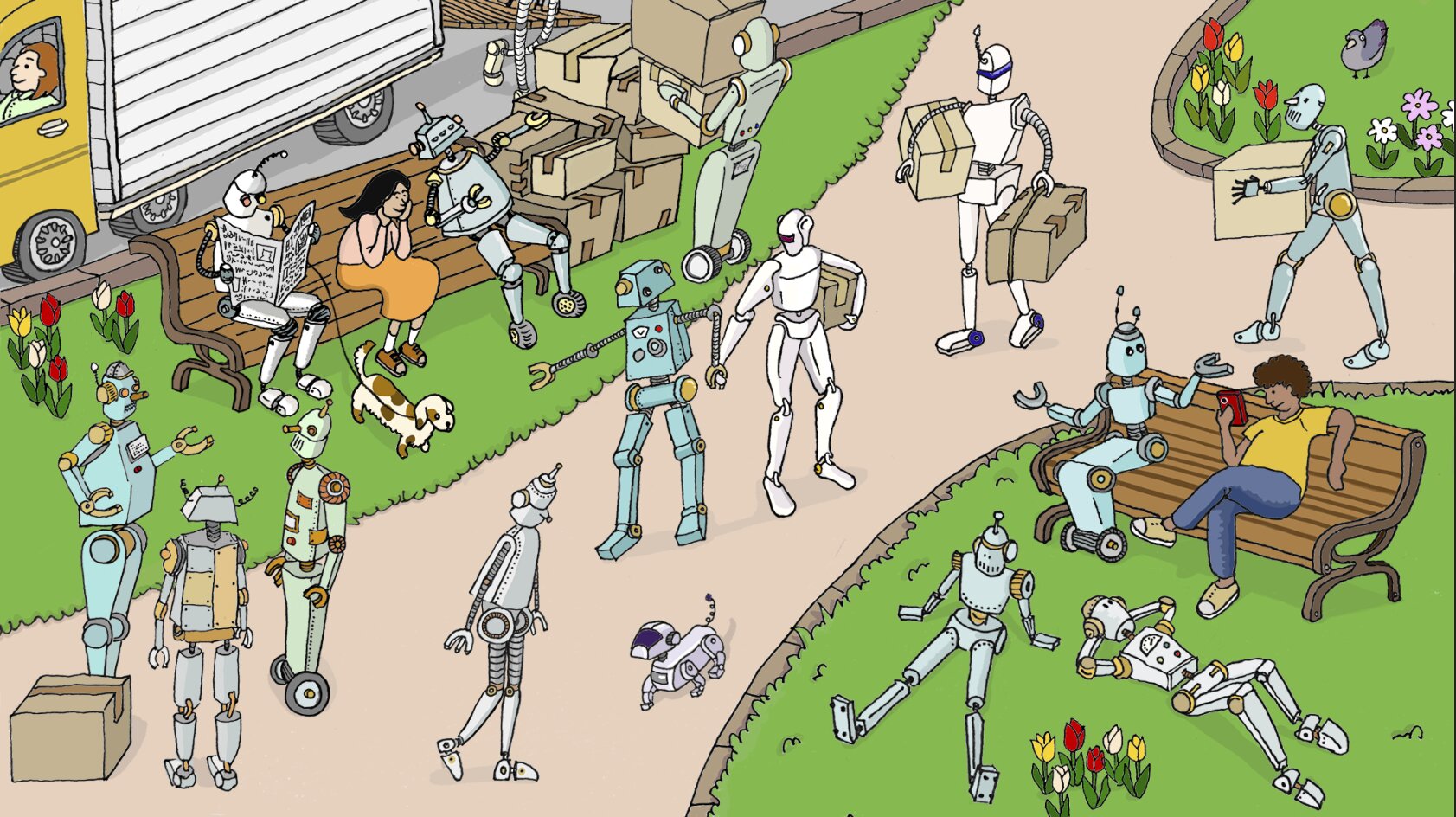

LLM 驅動的對話 AI 構成了 ChatGPT 等技術的基礎。這些技術使電腦能夠以類似於人與人之間交流的方式與人互動。名古屋大學團隊的目標是研究如何利用法學碩士來形成提示,以鼓勵社交互動中更多樣化的個性特徵。

人工智慧的個性被進化為透過玩囚徒困境遊戲來獲得虛擬收入博弈論。困境包括每個玩家選擇是與他們的伙伴合作還是背叛。如果兩個人工智慧系統合作,它們每人都會收到四美元虛擬美元。然而,如果一個人背叛而另一個人合作,背叛者得到五美元,而合作者什麼也得不到。如果兩人都背叛,他們將每人獲得一美元。

「在這項研究中,我們著手調查具有不同人格特徵的人工智慧體如何相互作用和進化,」Arita 解釋道。「透過利用法學碩士的卓越能力,我們開發了一個框架,人工智慧代理可以根據其基因中編碼的人格特徵的自然語言描述來進化。

「透過這個框架,我們觀察到了各種類型的人格特徵,人工智慧的演化能夠在自私和合作行為之間切換,反映了人類行為」。

在演化博弈論的通常研究中,模型中的「基因」直接決定主體的行為。利用法學碩士,Arita 和 Suzuki 探索了比以前的模型更複雜的描述的基因,例如「對團隊努力持開放態度,同時優先考慮自身利益,導致合作與背叛的結合。

該研究使用了進化框架,其中人工智慧代理的能力是透過幾代人的自然選擇和突變而形成的。這導致了各種各樣的人格特質的出現。

儘管一些代理人表現出自私的特徵,將自己的利益置於社區或整個群體的利益之上,但其他代理人則表現出先進的策略,以尋求個人利益為中心,同時仍然考慮共同利益和集體利益。

鈴木說:「我們的實驗為人工智慧個體的人格特徵的進化動態提供了令人著迷的見解。我們觀察到人工智慧群體中出現了合作和自私的人格特徵,這讓人想起人類的社會動態。 」

“然而,我們也發現了人工智慧社會固有的不穩定性,過度合作的群體被更加‘以自我為中心’的代理人所取代。”

「這項成就強調了法學碩士在人工智慧研究中的變革潛力,表明性格基於微妙語言表達的特徵可以透過使用法學碩士的計算模型來表示,」鈴木說。

“我們的研究結果提供了對人工智慧代理為人類社會做出貢獻應具備的特徵的見解,以及人工智能社會和人工智能與人類混合社會的設計指南,這些指南預計將在不久的將來實現。 ”

更多資訊:Reiji Suzuki 等人,使用大型語言模型的與合作行為相關的人格特徵的演化模型,科學報告(2024)。DOI:10.1038/s41598-024-55903-y

引文:博弈論研究顯示人工智慧可以演化成更自私或合作的性格(2024 年,4 月 4 日)檢索日期:2024 年 4 月 4 日取自 https://techxplore.com/news/2024-04-game-theory-ai-evolve-selfish.html

本文檔受版權保護。除了出於私人學習或研究目的的任何公平交易外,不得未經書面許可,不得複製部分內容。所提供的內容僅供參考。