워털루 대학교에 기반을 둔 연구원 팀은 ChatGPT와 같은 대규모 언어 모델(LLM)이 어디서 정보를 얻고 해당 정보를 신뢰할 수 있는지 여부를 보여주는 "RAGE"라는 별명을 가진 새로운 도구를 만들었습니다.

ChatGPT와 같은 LLM은 "비지도 딥 러닝"을 사용하여 프로그래머와 사용자가 해독하기 어려운 방식으로 인터넷을 통해 연결하고 정보를 흡수합니다.더욱이 LLM은 '환각'에 취약합니다. 즉, 개념과 내용에 대해 설득력 있게 글을 씁니다.출처그것은 부정확하거나 존재하지 않습니다.

워털루 컴퓨터 공학 박사인 Joel Rorseth는 "LLM이 스스로 설명한다고 반드시 신뢰할 수는 없습니다."라고 말했습니다.연구의 학생이자 주요 저자."그것은 자신이 만들어낸 설명이나 인용을 제공할 수도 있습니다."

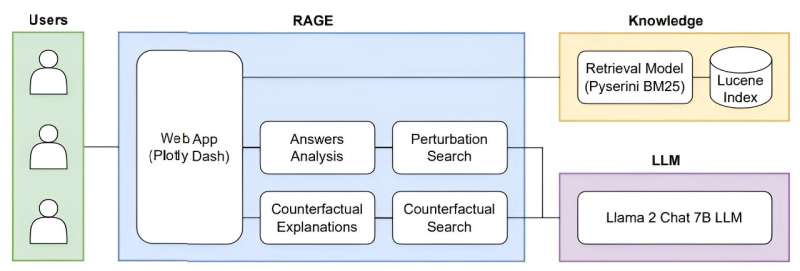

Rorseth 팀의 새로운 도구는 주어진 프롬프트에 대한 LLM의 답변에 대한 컨텍스트를 이해하기 위해 "RAG(검색 증강 생성)"이라는 최근 개발된 전략을 사용합니다.

"RAG를 사용하면 사용자가 상황에 맞게 LLM에 자신의 소스를 제공할 수 있습니다. 우리 도구는 RAG를 사용할 때 다양한 소스가 어떻게 다른 답변으로 이어지는지 보여줌으로써 해당 정보가 신뢰할 수 있는지 평가하는 데 도움이 됩니다."라고 Rorseth는 말했습니다.

그들의 도구는 검색-증강 생성 설명 가능성에 중점을 두기 때문에 "기계에 대한 'RAGE'"라는 별명을 붙였습니다.

ChatGPT와 같은 LLM이 정보를 얻는 위치를 이해하고 정보가 반복되지 않도록 합니다.오보Rorseth는 의료 및 법률 분야와 같이 매우 민감하고 인간 중심적인 산업이 이러한 도구를 채택함에 따라 더욱 중요해질 것이라고 말했습니다.

“우리는 지금 혁신이 규제를 앞지르는 상황에 있습니다.”라고 그는 말했습니다."사람들은 잠재적인 위험을 이해하지 못한 채 이러한 기술을 사용하고 있으므로 우리는 이러한 제품이 안전하고 신뢰할 수 있으며 신뢰할 수 있는지 확인해야 합니다."

"RAGE Against the Machine: Retrieval-Augmented LLM Descriptions"라는 연구는 제40회 IEEE 데이터 엔지니어링 국제 컨퍼런스 회보에 게재될 예정입니다.현재는사용 가능에arXiv사전 인쇄 서버.

추가 정보:Joel Rorseth 외, RAGE Against the Machine: 검색-증강 LLM 설명,arXiv(2024).DOI: 10.48550/arxiv.2405.13000

저널 정보: arXiv

소환:소스 파악: RAGE 도구로 ChatGPT 소스 공개(2024년 6월 4일)2024년 6월 4일에 확인함https://techxplore.com/news/2024-06-source-rage-tool-unveils-chatgpt.html에서

이 문서는 저작권의 보호를 받습니다.사적인 학습이나 조사를 목적으로 하는 공정한 거래를 제외하고는 어떠한 행위도 허용되지 않습니다.서면 허가 없이 일부를 복제할 수 있습니다.콘텐츠는 정보 제공 목적으로만 제공됩니다.