人類可以根據電話另一端的說話方式和內容來猜測對方的感受。語音情感辨識是這種能力的人工智慧版本。為了解決下游語音情緒辨識應用中的通道對齊問題,上海華東師範大學的研究小組開發了一種時間平移模組,該模組在微調和特徵提取場景中優於最先進的方法。

該小組的研究發表於 2 月 21 日智慧計算。

作者表示,“這種架構豐富可以提高性能,而不會增加計算負擔。”他們引入了三種具有不同架構的時間平移模型:卷積神經網絡,一個變壓器和一個長短期記憶循環神經網路。

實驗將這些時間平移模型與大型基準 IEMOCAP 資料集上的現有模型進行比較,發現它們通常更準確,特別是在微調場景中。當使用可訓練的加權和層級時,時間平移模型在特徵提取中也表現良好。

此外,時間平移模型在三個小型資料集 RAVDESS、SAVEE 和 CASIA 上的表現優於基線。此外,作為網路模組的時間移位優於用於資料增強的常見移位操作。

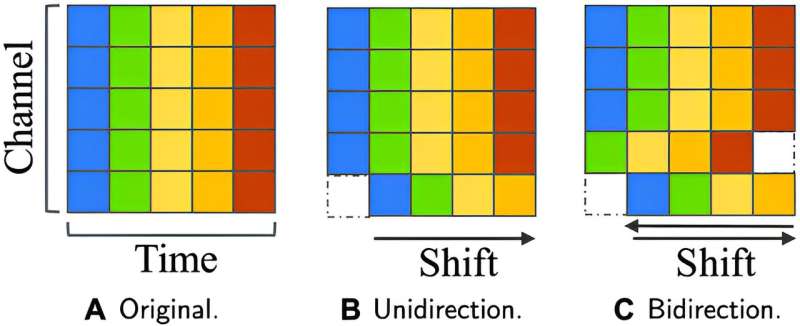

新的時間平移模組透過混合過去、現在和未來的特徵來實現更好的性能。雖然這種混合有利於準確性,但它也會導致錯位,從而損害準確性。

作者採用了兩種策略來解決這種權衡:控制輪班比例和選擇輪班。測試模型時,所有通道的二分之一、四分之一、八分之一和十六分之一都改變了;較大的比例允許更多的混合,但會導致更多的錯位。測試了兩種不同的放置模型:殘差移位(其中時間移位模組位於網路的分支上,因此將未移位的數據與移位的數據一起保留)和就地移位(移位所有數據)。

在研究了輪班比例和輪班位置後,作者為三種架構中的每一種選擇了性能最佳的變體,以便針對最先進的模型進行微調和特徵提取方面的實驗。

現有的依賴深度神經網路架構的語音情緒辨識方法是有效的,但它們面臨著準確性飽和的挑戰。也就是說,它們的準確性不會隨著網路規模的增量增加而增加。問題的關鍵部分是通道資訊和時間資訊沒有被獨立處理。

未來的工作可以研究資料集的規模和下游模型的複雜性對準確性的影響。其他下游任務,例如音訊分類,值得進行定量分析。此外,使時間平移模型的未來版本的參數可學習以實現自動最佳化將是有利的。

更多資訊:Siyuan Shen 等人,具有用於語音情緒識別的預訓練表示的時間平移模組,智慧計算(2024)。DOI:10.34133/icomputing.0073

引文:語音情緒辨識的時間轉變(2024 年,7 月 15 日)檢索日期:2024 年 7 月 15 日來自 https://techxplore.com/news/2024-07-temporal-shift-speech-emotion-recognition.html

本文檔受版權保護。除了出於私人學習或研究目的的任何公平交易外,不得未經書面許可,不得複製部分內容。所提供的內容僅供參考。