Según un nuevo artículo, el uso de conjuntos de datos generados por IA para entrenar futuras generaciones de modelos de aprendizaje automático puede contaminar su producción, un concepto conocido como colapso del modelo.publicadoenNaturaleza.La investigación muestra que, en unas pocas generaciones, el contenido original es reemplazado por tonterías no relacionadas, lo que demuestra la importancia de utilizar datos confiables para entrenar modelos de IA.

Herramientas de IA generativa comograndes modelos de lenguaje(LLM) han ganado popularidad y se han capacitado principalmente utilizando aportes generados por humanos.Sin embargo, a medida que estos modelos de IA continúan proliferando en Internet, el contenido generado por computadora puede usarse para entrenar otros modelos de IA (o a ellos mismos) en un ciclo recursivo.

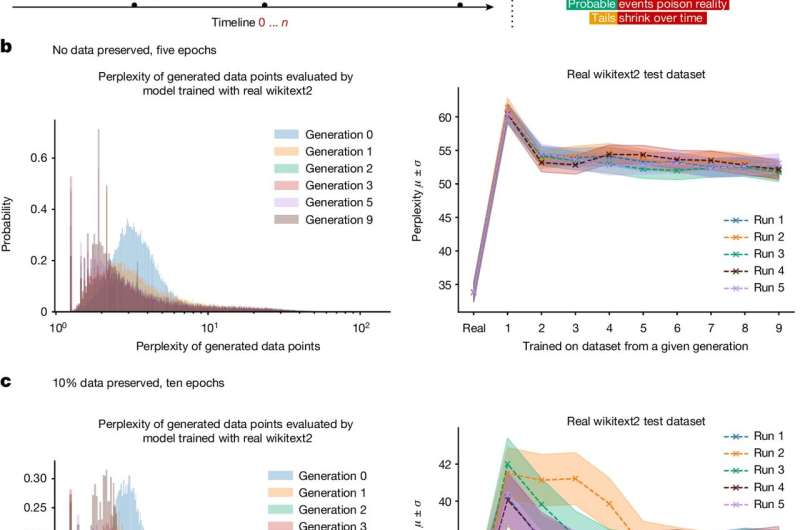

Ilia Shumailov y sus colegas presentan modelos matemáticos para ilustrar cómo los modelos de IA pueden experimentar un colapso.Los autores demuestran que una IA puede pasar por alto ciertos resultados (por ejemplo, líneas de texto menos comunes) en los datos de entrenamiento, lo que hace que se entrene solo en una parte del conjunto de datos.

Shumailov y sus colegas también investigaron cómo respondieron los modelos de IA a un conjunto de datos de entrenamiento creado predominantemente coninteligencia artificial.Descubrieron que alimentar un modelo con datos generados por IA hace que las generaciones sucesivas degraden su capacidad de aprender, lo que eventualmente lleva al colapso del modelo.

Casi todos los modelos de lenguaje entrenados recursivamente que probaron tendían a mostrar frases repetidas.Por ejemplo, se realizó una prueba utilizando texto sobre arquitectura medieval como entrada original y en el novenogeneraciónel resultado fue una lista de liebres.

Los autores proponen que el colapso del modelo es un resultado inevitable de los modelos de IA que utilizan conjuntos de datos de entrenamiento creados por generaciones anteriores.Para entrenar con éxito la inteligencia artificial con sus propios resultados, Shumailov y sus colegas sugieren que entrenar un modelo con datos generados por IA no es imposible, pero el filtrado de esos datos debe tomarse en serio.

Al mismo tiempo, las empresas de tecnología que dependen de contenido generado por humanos pueden entrenar modelos de IA que sean más efectivos que sus competidores.

Más información:Ilia Shumailov et al, los modelos de IA colapsan cuando se entrenan con datos generados de forma recursiva,Naturaleza(2024).DOI: 10.1038/s41586-024-07566-y

Citación:Uso de IA para entrenar IA: el colapso del modelo podría estar llegando para los LLM, dicen los investigadores (2024, 25 de julio)recuperado el 25 de julio de 2024de https://techxplore.com/news/2024-07-ai-collapse-llms.html

Este documento está sujeto a derechos de autor.Aparte de cualquier trato justo con fines de estudio o investigación privados, noparte puede ser reproducida sin el permiso por escrito.El contenido se proporciona únicamente con fines informativos.