La Inteligencia Artificial sustenta hoy muchas de nuestras actividades en las esferas pública y privada, incluidos el trabajo, la educación, los viajes y el ocio.Pero su rápido desarrollo y mayor uso han sido impulsados principalmente por intereses comerciales más que por decisiones políticas o legislativas deliberativas.

Como resultado, existe una creciente inquietud sobre el impacto sobre los derechos humanos individuales y colectivos, como la privacidad y la libertad de expresión, así como la propiedad intelectual.

Recientemente, esta preocupación se ha traducido en una ola de iniciativas regulatorias globales, regionales y nacionales.ElLey de Inteligencia Artificial de la Unión Europea, que se espera entre en vigor el próximo mes, es innovador en alcance y escala.

Esta ley va más allá de iniciativas globales y nacionales anteriores (como cartas de IA responsables y declaraciones éticas de IA) hacia un marco regulatorio integral, que incluye un régimen de aplicación y sanciones.

Algunas empresas con sede en Nueva Zelanda pueden incurrir en requisitos de cumplimiento específicos (si su producto está disponible en el mercado de la UE o afecta a personas en la UE), pero de mayor importancia será la influencia de la ley en las normas globales.

La UE es el mayor mercado mundial yun emisor de estándares globales.Y dados los vínculos más estrechos que se están forjando a través del Tratado de Libre Comercio entre Nueva Zelanda y la UE, Nueva Zelanda debería seguir de cerca la evolución regulatoria.

La Ley de IA de la UE se considera mejor como una legislación sobre seguridad de los productos, cuyo objetivo es proteger a las personas de daños y promover el uso confiable y seguro de la IA.

Su estructura central es un marco basado en riesgos para la IA, con requisitos escalonados según el nivel de riesgo.Los sistemas de IA de alto riesgo (por ejemplo, los sistemas utilizados en el empleo, la educación y la infraestructura crítica) estarán sujetos a una evaluación de conformidad, donde el proveedor deberá demostrar el cumplimiento de requisitos como la transparencia y la ciberseguridad.

La mayoría de los sistemas de alto riesgo deberán registrarse en una base de datos pública.Se están estableciendo estructuras de gobernanza a nivel de la UE y en las jurisdicciones de la UE para monitorear el cumplimiento, establecer estándares para la implementación y brindar asesoramiento experto.

De interés global son las decisiones sobre la prohibición de algunos tipos de IA (a través de la categorización de "riesgo inaceptable" de la ley).Es probable que estas decisiones den forma a la evolución del debate global sobre si algunos sistemas de IA deberían prohibirse completamente por ser incompatibles con los derechos fundamentales y la dignidad humana.

Los sistemas que la ley prohibirá incluyen puntuación social, extracción de imágenes y la mayoría de los tipos de reconocimiento de emociones, categorización biométrica y aplicaciones policiales predictivas.

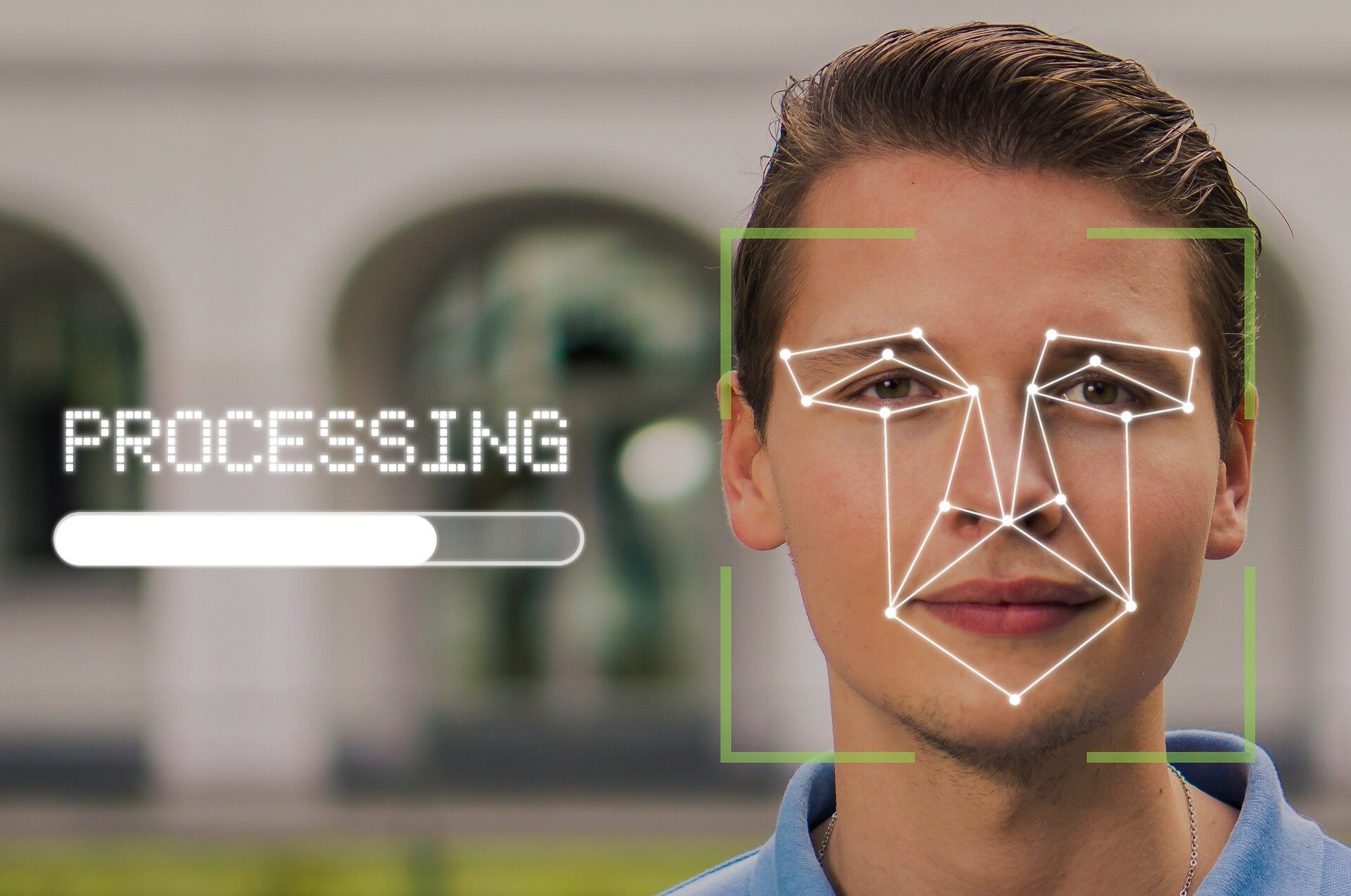

Sin embargo, a pesar de la acción concertada de los grupos de libertades civiles, la regulación no llega a una prohibición total deen tiempo realVigilancia biométrica remota: la tecnología de reconocimiento facial en vivo es el ejemplo más familiar.

Aunque este tipo de vigilancia se encuentra en la categoría de "riesgo inaceptable", existen importantes excepciones para fines de aplicación de la ley, como se explora enleyes.Más,seguridad nacional, defensa y fines militares quedan fuera del ámbito de competencia de la ley.Esto significa que la tecnología seguirá utilizándose.

También existe un riesgo significativo de que, al definir los casos en los que se justifica la vigilancia biométrica remota en tiempo real, se pueda considerar que la UE está respaldando la tecnología como aceptable, lo que tal vez conduzca a un mayor uso en jurisdicciones nacionales sin el necesario respaldo o compromiso de la comunidad con autoridades particularmente.grupos afectados.

En la lucha global por albergar y desarrollar centros tecnológicos, existe un debate considerable sobre qué entornos regulatorios promueven mejor la innovación en IA.Algunos sostienen que el enfoque de la UE podría estrangular la innovación, pero otros dirían que la certeza y las líneas claras proporcionan una base firme para la inversión y la innovación.

En general, el enfoque de la UE se basa en la idea de que cuando los consumidores confían en los sistemas y en la calidad, es más probable que estén dispuestos a utilizar la IA en el sentido comercial y al interactuar con los servicios públicos.

Entonces, ¿qué puede aprender Nueva Zelanda del enfoque de la UE?

Nueva Zelanda tiene importantes lagunas en su régimen regulatorio que pueden obstaculizar la innovación y poner en peligro la confianza del público en la IA.

Existe un régimen de protección de datos y privacidad comparativamente débil, una falta de vías accesibles para que las personas y las comunidades sepan cuándo se utiliza la IA o presenten quejas sobre el impacto de la IA y tecnologías similares en sus derechos e intereses, una falta de aplicación o sanción estrictay un régimen legislativo obsoleto para la vigilancia estatal.

Sin un marco regulatorio sólido, confiable y centrado en las personas, es probable que la aceptación y la confianza en la IA se vean afectadas.Aunque Aotearoa Nueva Zelanda tiene una estructura social ycontexto culturalAl requerir un enfoque personalizado, los conceptos y el marco de la Ley de IA de la UE proporcionan una base sólida para una regulación de la IA centrada en las personas.

Más información:Nessa Lynch, Tecnología de reconocimiento facial en vigilancia y seguridad: estudios de caso en regulación,leyes(2024).DOI: 10.3390/leyes13030035

Citación:Controlar la IA: lo que Nueva Zelanda puede aprender de la regulación de la UE (2024, 12 de julio)recuperado el 12 de julio de 2024de https://techxplore.com/news/2024-07-reining-ai-nz-eu.html

Este documento está sujeto a derechos de autor.Aparte de cualquier trato justo con fines de estudio o investigación privados, noparte puede ser reproducida sin el permiso por escrito.El contenido se proporciona únicamente con fines informativos.