por Joseph E. Harmon,

El aprendizaje profundo es una forma de inteligencia artificial que transforma la sociedad al enseñar a las computadoras a procesar información utilizando redes neuronales artificiales que imitan el cerebro humano.Ahora se utiliza en reconocimiento facial, vehículos autónomos e incluso en juegos complejos como Go.En general, el éxito del aprendizaje profundo ha dependido del uso de grandes conjuntos de datos de imágenes etiquetadas con fines de capacitación.

Una potencial mina de oro de imágenes etiquetadas reside dentroliteratura científica, con más de un millón de artículos publicados cada año.La mayoría tiene muchas figuras entretejidas en el texto.Hasta la fecha, estas cifras no han sido susceptibles deaprendizaje profundomodelos.Esto se debe, en parte, a sus complejos diseños.Cada figura suele contener varias imágenes, gráficos e ilustraciones incrustados.También ha faltado un medio adecuado para buscar en la literatura imágenes que coincidan con un contenido específico.

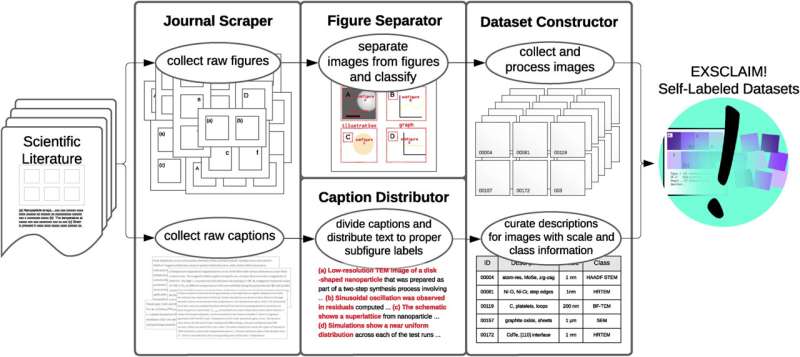

Para abordar este desafío, investigadores del Laboratorio Nacional Argonne del Departamento de Energía de EE. UU. (DOE) y la Universidad Northwestern han creado EXSCLAIM!herramienta informática.El nombre significa extracción, separación y anotación de imágenes en lenguaje natural basada en subtítulos.

Los hallazgos sonpublicadoen el diarioPatrones.

"Imágenes generadas pormicroscopios electrónicos"Hasta las mil millonésimas de metro son uno de los tipos de cifras más importantes en la literatura sobre ciencia de materiales", dijo Maria Chan, científica del Centro de Materiales a Nanoescala de Argonne, una instalación para usuarios de la Oficina de Ciencias del DOE. "Estas imágenes son esenciales para comprendery desarrollo de nuevos materiales en muchos campos diferentes.¡Nuestro objetivo con EXSCLAIM!es desbloquear el potencial sin explotar de estos datos de imágenes".

Lo que pone EXSCLAIM!Lo que destaca es su enfoque único en un enfoque de consulta a conjunto de datos, similar a cómo se usa un mensaje con herramientas de inteligencia artificial generativa como ChatGPT y DALL-E.De este modo, es capaz de extraer imágenes individuales con contenido muy específico de figuras, ya que clasifica el contenido de la imagen y reconoce el grado de ampliación.Luego puede crear etiquetas descriptivas para cada imagen.Este innovadorherramienta de softwareSe espera que se convierta en un activo valioso para los científicos que investigan nuevos materiales a nanoescala.

"Si bien los métodos existentes a menudo luchan con el problema del diseño compuesto, EXSCLAIM! emplea un nuevo enfoque para superarlo", dijo el autor principal Eric Schwenker, ex estudiante graduado de Argonne."Nuestro software es eficaz para identificar límites nítidos de imágenes y destaca en la captura de disposiciones de imágenes irregulares".¡EXCLAMA!

ya ha demostrado su eficacia mediante la construcción de un conjunto de datos de microscopía electrónica autoetiquetado de más de 280.000 imágenes de nanoestructuras.Aunque inicialmente se desarrolló en torno a imágenes de microscopía de materiales, ¡EXSCLAIM!Es adaptable a cualquier campo científico que produzca grandes volúmenes de artículos con imágenes.Por tanto, el software promete revolucionar el uso de imágenes científicas publicadas en diversas disciplinas.

"Los investigadores ahora tienen una poderosa herramienta de extracción de imágenes para avanzar en su comprensión de la información visual compleja", dijo Chan.

Más información:Eric Schwenker et al, ¡EXSCLAIM!: Aprovechamiento de la literatura sobre ciencia de materiales para conjuntos de datos de microscopía autoetiquetados,Patrones(2023).DOI: 10.1016/j.patter.2023.100843

Citación:Nuevo código extrae imágenes de microscopía en artículos científicos (9 de abril de 2024)recuperado el 9 de abril de 2024de https://techxplore.com/news/2024-04-code-microscopy-images-scientific-articles.html

Este documento está sujeto a derechos de autor.Aparte de cualquier trato justo con fines de estudio o investigación privados, noparte puede ser reproducida sin el permiso por escrito.El contenido se proporciona únicamente con fines informativos.