Desde que se descubrió en la década de 1980 que el aprendizaje en el cerebro del conejo utiliza el caos, este comportamiento dinámico no lineal e inicialmente sensible a los valores ha sido cada vez más reconocido como parte integral del aprendizaje cerebral.

Sin embargo, los algoritmos de aprendizaje modernos pararedes neuronales artificiales, particularmente las redes neuronales (SNN) que se parecen mucho al cerebro, no han capitalizado eficazmente esta característica.

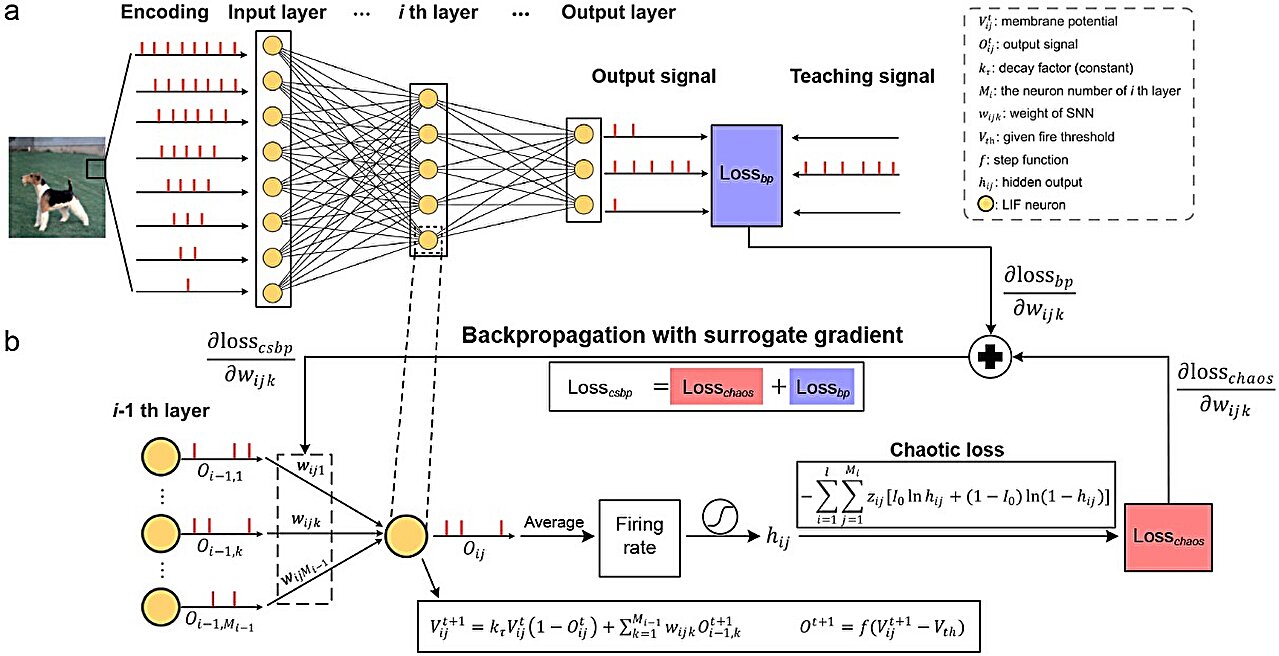

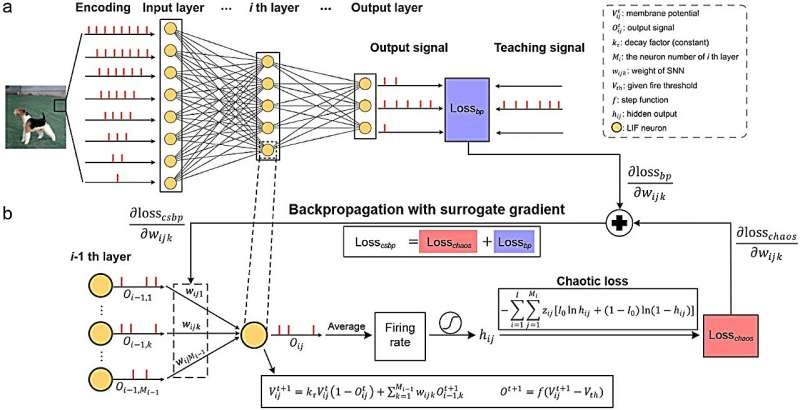

Zijian Wang y Peng Tao, junto con el director del laboratorio, Luonan Chen, se esforzaron por introducir dinámicas caóticas intrínsecas en el cerebro en los algoritmos de aprendizaje de los SNN existentes.Descubrieron que esto podría lograrse simplemente integrando una función de pérdida análoga a la entropía cruzada (ver imagen a continuación).

Además, observaron que un SNN equipado con dinámica caótica no solo mejora el rendimiento de aprendizaje/optimización sino que también mejora el rendimiento de generalización tanto en conjuntos de datos neuromórficos (por ejemplo, DVS-CIFAR10 y DVS-Gesture) como en conjuntos de datos estáticos a gran escala (por ejemplo, CIFAR100 yImageNet), con la ayuda de las propiedades ergódicas y pseudoaleatorias del caos.

El equipo también experimentó con la introducción de caos extrínseco, como mediante el uso de mapas logísticos.Sin embargo, esto no mejoró el rendimiento del aprendizaje de los SNN."Éste es un resultado apasionante e implica que el factor intrínsecocaos"El hecho de que el cerebro haya evolucionado a lo largo de miles de millones de años juega un papel importante en su eficiencia en el aprendizaje", afirma Luonan Chen.Aunque los SNN tienen una caracterización de señal espacio-temporal más fuerte y una mayor eficiencia en la utilización de energía, su rendimiento a menudo va por detrás del de las redes neuronales tradicionales de tamaño equivalente debido a la falta de sistemas eficientes.

algoritmos de aprendizaje.Este nuevo algoritmo cierra eficazmente esta brecha.Además, dado que solo es necesario introducir una función de pérdida adicional, se puede emplear como una unidad complementaria generalizada con metodologías de aprendizaje SNN existentes.

El estudio espublicadoen el diarioRevista Nacional de Ciencias.

Más información:Zijian Wang et al, Propagación hacia atrás de picos caóticos inspirados en el cerebro,Revista Nacional de Ciencias(2024).DOI: 10.1093/nsr/nwae037

Información de la revista: Caos

Citación:Propagación hacia atrás de picos caóticos inspirados en el cerebro (29 de marzo de 2024)recuperado el 29 de marzo de 2024de https://techxplore.com/news/2024-03-brain-chaotic-spiking-backpropagation.html

Este documento está sujeto a derechos de autor.Aparte de cualquier trato justo con fines de estudio o investigación privados, noparte puede ser reproducida sin el permiso por escrito.El contenido se proporciona únicamente con fines informativos.