Los modelos de lenguaje de IA están en auge.El líder actual es ChatGPT, que puede hacer de todo, desde realizar un examen de abogacía hasta crear una política de recursos humanos y escribir el guión de una película.

Pero este y otros modelos todavía no pueden razonar como un ser humano.En esta sesión de preguntas y respuestas, la Dra. Vered Shwartz, profesora asistente del departamento de informática de la UBC, y el estudiante de maestría Mehar Bhatia explican por quérazonamientopodría ser el siguiente paso en IA... y por qué es importante entrenar estos modelos utilizando diversos conjuntos de datos dediferentes culturas.

¿Qué es el "razonamiento" de la IA?

Shwartz: Los grandes modelos de lenguaje como ChatGPT aprenden leyendo millones de documentos, esencialmente todo Internet, y reconociendo patrones para producir información.Esto significa que sólo pueden proporcionar información sobre cosas que están documentadas en Internet.Los humanos, por otro lado, son capaces de utilizar el razonamiento.Usamos la lógica y el sentido común para encontrar significados más allá de lo que se dice explícitamente.

Bhatia: Aprendemos habilidades de razonamiento desde que nacemos.Por ejemplo, sabemos que no debemos encender la licuadora a las 2 a. m. porque despertará a todos.No nos enseñan esto, pero es algo que entiendes en función de la situación, tu entorno y tu entorno.En un futuro próximo, los modelos de IA se encargarán de muchas de nuestras tareas.No podemos codificar cada regla de sentido común en estos robots, por lo que queremos que comprendan qué es lo correcto en un contexto específico.

Shwartz: Aprovechándose del razonamiento de sentido común paramodelos actualescomo ChatGPT les ayudaría a proporcionar respuestas más precisas y, por tanto, a crear herramientas más potentes para que las utilicen los humanos.Los modelos actuales de IA han mostrado alguna forma de razonamiento de sentido común.Por ejemplo, si le preguntas a la última versión de ChatGPT sobre el pastel de barro de un niño y de un adulto, puede diferenciar correctamente entre un postre y una cara llena de suciedad según el contexto.

¿Dónde fallan los modelos de lenguaje de IA?

Shwartz: El razonamiento de sentido común en los modelos de IA está lejos de ser perfecto.Sólo llegaremos hasta cierto punto entrenándonos con cantidades masivas de datos.Los seres humanos seguirán necesitando intervenir y entrenar los modelos, incluso proporcionando los datos correctos.

Por ejemplo, sabemos que el texto en inglés en la web proviene en gran medida de América del Norte, por lo que los modelos de idioma inglés, que son los más utilizados, tienden a tener un sesgo norteamericano y corren el riesgo de no conocer conceptos de otras culturas ode perpetuar estereotipos.

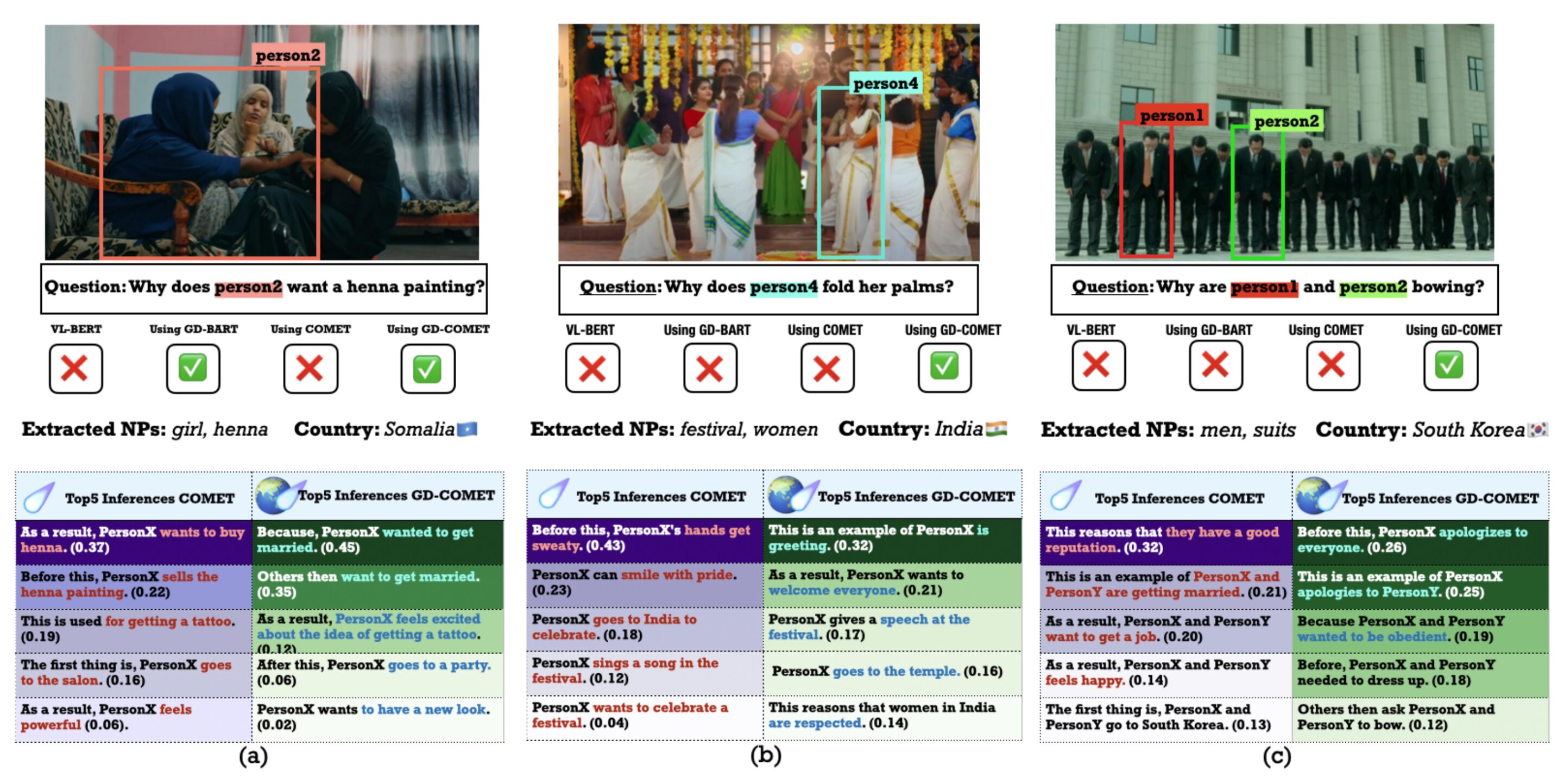

en unartículo reciente(publicado enActas de la Conferencia de 2023 sobre métodos empíricos en el procesamiento del lenguaje natural), descubrimos que entrenar un modelo de razonamiento de sentido común con datos de diferentes culturas, incluidas India, Nigeria y Corea del Sur, dio como resultado respuestas más precisas y culturalmente informadas.

Bhatia: Un ejemplo incluyó mostrarle a la modelo una imagen de una mujer en Somalia haciéndose un tatuaje de henna y preguntarle por qué querría hacerlo.Cuando se entrenó con datos culturalmente diversos, el modelo sugirió correctamente que estaba a punto de casarse, mientras que anteriormente había dicho que quería comprar henna.

Shwartz: También encontramos ejemplos de ChatGPT que carecen de conciencia cultural.Cuando se les presentó una situación hipotética en la que una pareja dejaba una propina del cuatro por ciento en un restaurante en España, el modelo sugirió que tal vez no estaban satisfechos con el servicio.Esto supone que la cultura norteamericana de propinas se aplica en España cuando, en realidad, las propinas no son comunes en el país, y una propina del cuatro por ciento probablemente significa un servicio excepcional.

¿Por qué debemos asegurarnos de que la IA sea más inclusiva?

Shwartz: Los modelos lingüísticos son omnipresentes.Si estos modelos asumen el conjunto de valores y normas asociados con la cultura occidental o norteamericana, su información para y sobre personas de otras culturas podría ser inexacta y discriminatoria.Otra preocupación es que la gente dediversos orígenesEl uso de productos impulsados por modelos ingleses tendría que adaptar sus insumos a las normas norteamericanas, o de lo contrario podrían obtener un rendimiento subóptimo.

Bhatia: Queremos que estas herramientas las utilicen todos, no solo un grupo de personas.Canadá es un país culturalmente diverso y debemos asegurarnos de que las herramientas de inteligencia artificial que impulsan nuestras vidas no reflejen solo unaculturay sus normas.Nuestra investigación en curso tiene como objetivo fomentar la inclusión, la diversidad y la sensibilidad cultural en el desarrollo y la implementación de tecnologías de IA.

Más información:Mehar Bhatia et al, GD-COMET: un modelo de inferencia de sentido común geodiverso,Actas de la Conferencia de 2023 sobre métodos empíricos en el procesamiento del lenguaje natural(2023).DOI: 10.18653/v1/2023.emnlp-main.496

Citación:Preguntas y respuestas: ChatGPT ha leído casi todo Internet.Eso no ha solucionado sus problemas de diversidad (2024, 11 de enero)recuperado el 11 de enero de 2024de https://techxplore.com/news/2024-01-qa-chatgpt-internet-hasnt-diversity.html

Este documento está sujeto a derechos de autor.Aparte de cualquier trato justo con fines de estudio o investigación privados, noparte puede ser reproducida sin el permiso por escrito.El contenido se proporciona únicamente con fines informativos.