Los sensores de visión neuromórficos son dispositivos de detección únicos que responden automáticamente a los cambios ambientales, como un brillo diferente en el entorno que los rodea.Estos sensores imitan el funcionamiento del sistema nervioso humano, replicando artificialmente la capacidad de las neuronas sensoriales para responder preferentemente a los cambios en el entorno detectado.

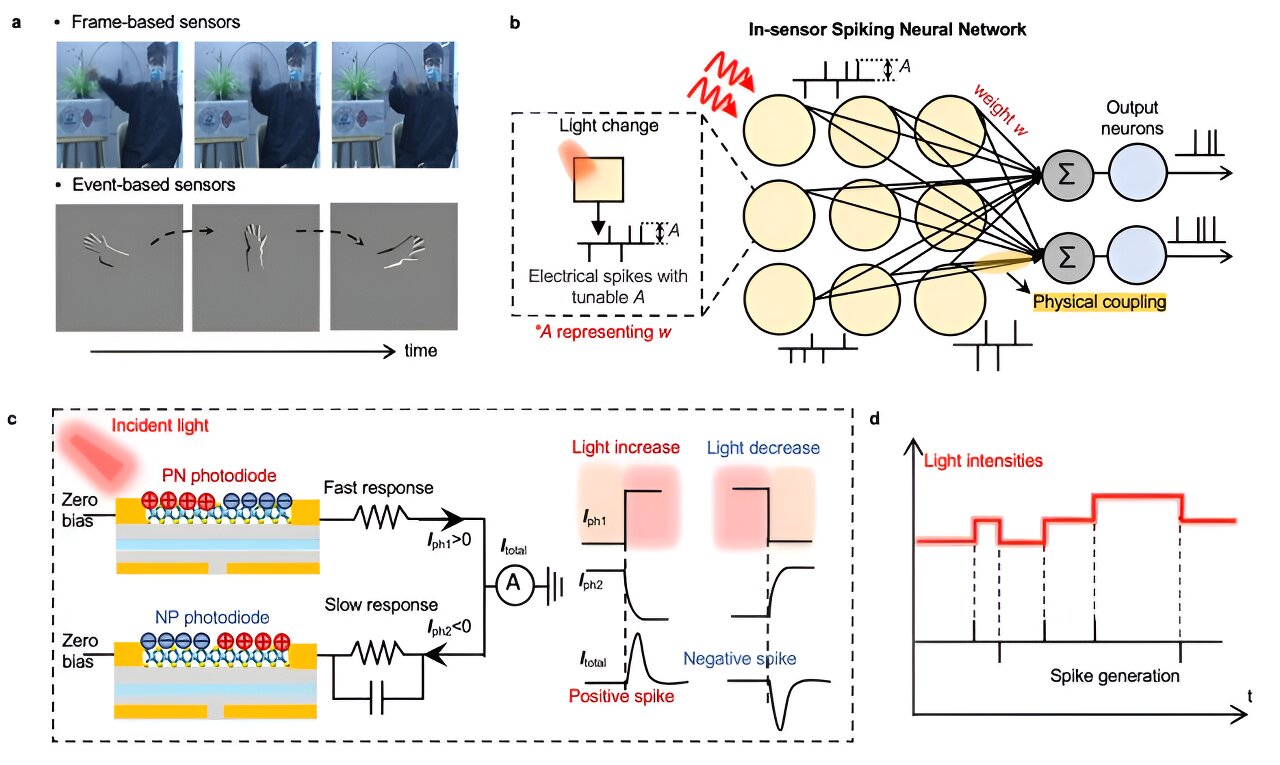

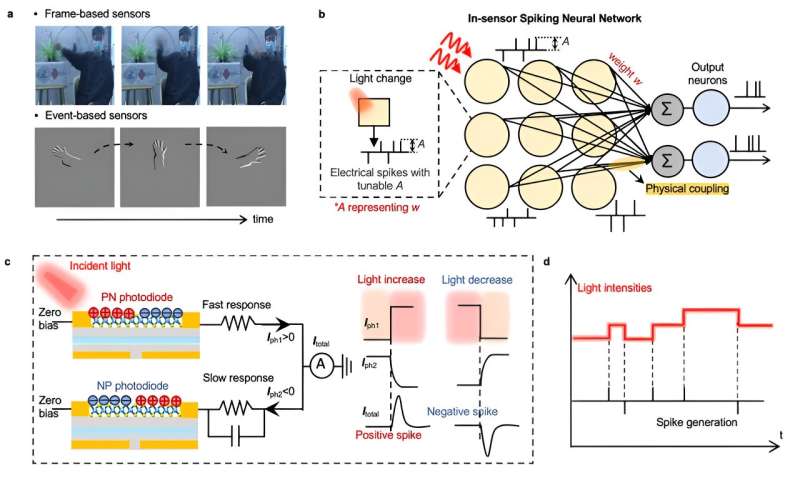

Por lo general, estos sensores únicamente capturan movimientos dinámicos en una escena, que luego se envían a una unidad computacional que los analizará e intentará reconocer cuáles son.Estos diseños de sistemas, en los que los sensores y las unidades computacionales que procesan los datos que recopilan están físicamente separados, pueden crear una latencia en el procesamiento de los datos de los sensores, al tiempo que consumen más energía.

Investigadores de la Universidad Politécnica de Hong Kong, la Universidad de Ciencia y Tecnología de Huazhong y la Universidad de Ciencia y Tecnología de Hong Kong desarrollaron recientemente nuevos sensores de visión impulsados por eventos que capturan el movimiento dinámico y también pueden convertirlo en señales de picos programables.Estos sensores, presentados en un artículopublicadoenElectrónica de la naturaleza, elimina la necesidad de transferir datos de sensores a unidades computacionales, lo que permite mejores eficiencias energéticas y velocidades más rápidas en el análisis de movimientos dinámicos capturados.

"La arquitectura informática en el sensor y cerca del sensor disminuye eficientemente la latencia de la transferencia de datos y el consumo de energía al realizar tareas de cálculo directamente cerca o dentro de los terminales sensoriales", dijo a Tech Xplore Yang Chai, coautor del artículo."Nuestro grupo de investigación se dedica al estudio de dispositivos personalizados emergentes para computación en sensores cercanos y en sensores. Sin embargo, descubrimos que los trabajos existentes se centran en sensores convencionales basados en marcos, que generan una gran cantidad de datos redundantes".

Los avances recientes en el desarrollo de redes neuronales artificiales (RNA) han abierto nuevas oportunidades para el desarrollo de dispositivos de detección neuromórficos y sistemas de reconocimiento de imágenes.Como parte de su estudio reciente, Chai y sus colegas se propusieron explorar el potencial de combinar sensores basados en eventos con picos.redes neuronales(SNN), RNA que imitan los patrones de activación de las neuronas."La combinación de sensores basados en eventos y una red neuronal de picos (SNN) para el análisis de movimiento puede reducir efectivamente los datos redundantes y reconocer el movimiento de manera eficiente", dijo Chai.

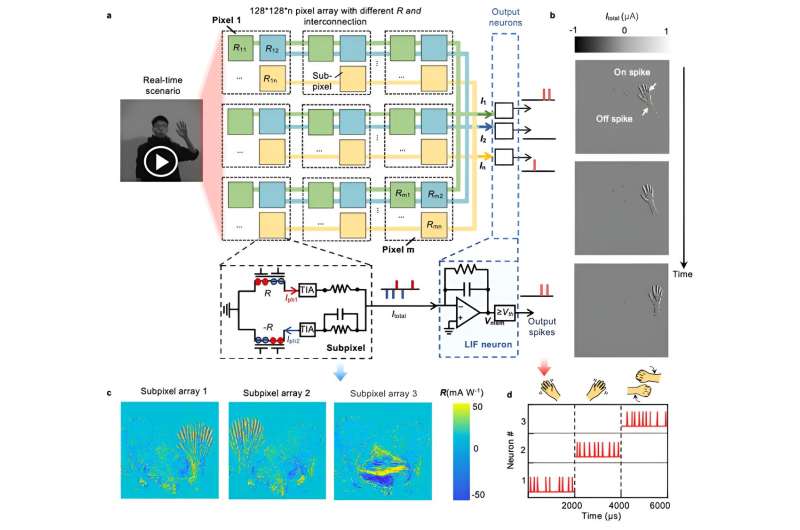

"Por lo tanto, proponemos la arquitectura de hardware con píxeles de dos fotodiodos con funciones de sensores basados en eventos y sinapsis que pueden lograr SNN en el sensor".

Los nuevos sensores de visión computacionales impulsados por eventos desarrollados por Chai y sus colegas son capaces tanto de detectar eventos como de realizar cálculos.Básicamente, estos sensores generan picos programables en respuesta a cambios en el brillo y la intensidad de la luz de los píxeles grabados localmente.

"La característica impulsada por eventos se logra mediante el uso de dos ramas con fotorespuesta opuesta y diferentes tiempos de respuesta fotográfica que generan señales de picos impulsadas por eventos", explicó Chai."La característica sináptica se realiza mediante fotodiodos con diferentes fotorresponsividades que permiten una modulación precisa de la amplitud de las señales de pico, emulando diferentes pesos sinápticos en un SNN".

Los investigadores evaluaron sus sensores en una serie de pruebas iniciales y descubrieron que emulan eficazmente los procesos mediante los cuales las neuronas del cerebro se adaptan a los cambios en las escenas visuales.En particular, estos sensores reducen la cantidad de datos que recopilarán, al tiempo que eliminan la necesidad de transferir estos datos a una unidad computacional externa.

"Nuestro trabajo propone un método para detectar y procesar el escenario capturando el nivel de píxel localintensidad de la luzcambio, logrando así SNN en el sensor en lugar de ANN convencional", dijo Chai. "Dicho diseño combina las ventajas de los sensores basados en eventos y la computación en el sensor, que es adecuada paraen tiempo realprocesamiento dinámico de información, como la conducción autónoma y los robots inteligentes".

En el futuro, los sensores de visión computacionales impulsados por eventos desarrollados por Chai y sus colegas podrían desarrollarse más y probarse en experimentos adicionales, para evaluar mejor su valor para aplicaciones del mundo real.Además, este trabajo reciente podría servir de inspiración para otros grupos de investigación, allanando así potencialmente el camino para nuevas tecnologías de detección que combinen sensores basados en eventos.sensoresy SNN."En el futuro, nuestro grupo se centrará en la realización a nivel de matriz y la tecnología de integración de matrices de sensores computacionales y circuitos CMOS para demostrar un sistema informático completo en el sensor", añadió Chai.

"Además, intentaremos desarrollar un punto de referencia para definir los requisitos métricos del dispositivo para diferentes aplicaciones y evaluar el rendimiento del sistema informático en el sensor de forma cuantitativa".

Más información:Yue Zhou et al, Sensores de visión computacionales impulsados por eventos para redes neuronales con picos en el sensor,Electrónica de la naturaleza(2023).DOI: 10.1038/s41928-023-01055-2

© 2023 Red Ciencia X

Citación:Sensores de visión computacionales impulsados por eventos que convierten el movimiento en señales de picos (20 de diciembre de 2023)recuperado el 20 de diciembre de 2023de https://techxplore.com/news/2023-12-event-driven-vision-sensors-motion-spiking.html

Este documento está sujeto a derechos de autor.Aparte de cualquier trato justo con fines de estudio o investigación privados, noparte puede ser reproducida sin el permiso por escrito.El contenido se proporciona únicamente con fines informativos.